Tecnologia de IA levanta questões éticas

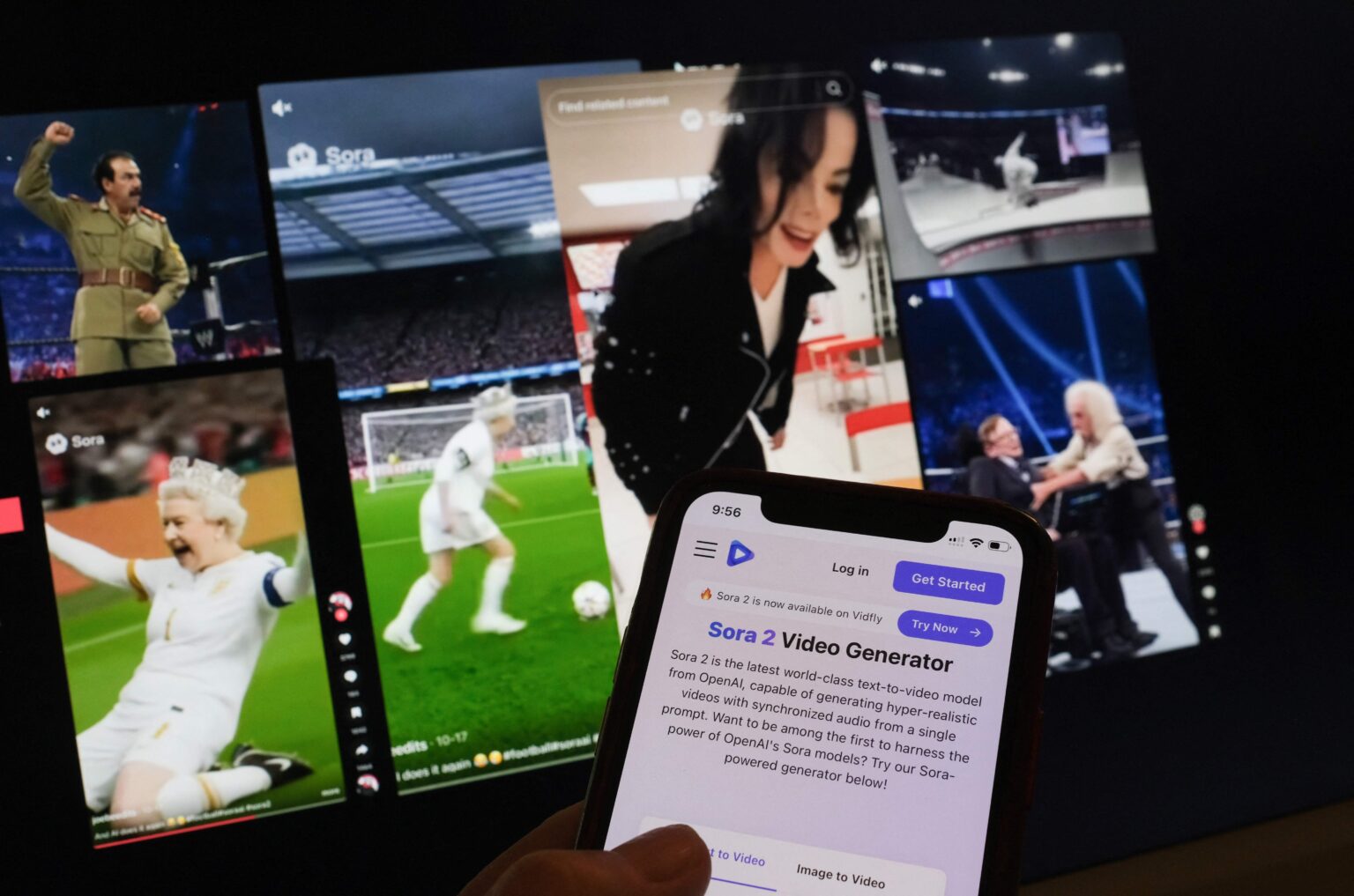

Recentemente, vídeos hiper-realistas gerados por inteligência artificial, mostrando celebridades e pessoas comuns já falecidas, têm causado controvérsias nas redes sociais. Aplicativos como o Sora, desenvolvido pela OpenAI, têm se tornado populares, mas também atraído críticas sobre o controle de imagem de figuras históricas e celebridades. Desde seu lançamento em setembro, a ferramenta tem produzido uma série de clipes que apresentam personalidades icônicas, como Winston Churchill, Michael Jackson e Elvis Presley, em situações inusitadas.

Um exemplo curioso inclui a rainha Elizabeth II, que em um vídeo no TikTok aparece em um combate de luta livre, enquanto em outro clipe no Facebook, ela elogia bolinhos de queijo em um supermercado. Esses conteúdos, embora possam gerar risos, têm levantado sérias preocupações sobre a ética por trás da criação de tais representações.

Reações e restrições à geração de vídeos

As críticas aumentaram quando a OpenAI decidiu impedir a geração de vídeos utilizando a imagem de Martin Luther King Jr., após reclamações de seus herdeiros. Alguns usuários chegaram a criar clipes em que King era retratado de maneira desrespeitosa, fazendo comentários ofensivos durante seu célebre discurso “I have a dream”.

Em um comentário sobre essa situação, Constance de Saint Laurent, professora da Universidade de Maynooth, na Irlanda, destacou o conceito do “vale da estranheza”, que sugere que quanto mais realista um objeto se torna, mais desconfortável ele pode ser. Ela afirmou: “Se, de repente, você começar a receber vídeos de um ente querido falecido, seria traumático. Estes vídeos têm consequências reais.”

Vozes de famílias e ativistas

Recentemente, membros da família de Robin Williams e do ativista Malcolm X expressaram seu descontentamento com o uso do Sora para criar vídeos de seus pais falecidos. Zelda Williams, filha do ator, fez um apelo no Instagram pedindo para que as pessoas parassem de enviar clipes de seu pai gerados por inteligência artificial. “É enlouquecedor”, ressaltou.

A OpenAI admitiu que há um forte interesse na representação de figuras históricas, mas enfatizou que as personalidades públicas e suas famílias devem ter controle sobre sua imagem. O porta-voz da empresa afirmou que representantes autorizados de personalidades falecidas podem solicitar que suas imagens não sejam utilizadas no aplicativo. Contudo, Hany Farid, cofundador da GetReal Security e professor da Universidade da Califórnia em Berkeley, criticou a situação: “Apesar de a OpenAI afirmar permitir que as pessoas controlem sua imagem, publicaram uma ferramenta que claramente faz o oposto.”

Proliferação de conteúdos sintéticos e seus riscos

Outro ponto levantado por Farid é a falta de restrições em relação ao uso da imagem de determinadas figuras públicas, que não se limita apenas ao Sora. Ele alertou que, mesmo com proteções implementadas pela OpenAI, outros modelos de inteligência artificial podem não ter tais limitações, o que torna a situação ainda mais preocupante. Este problema se intensificou após o assassinato do diretor de cinema Rob Reiner, cujas imagens também foram utilizadas em clipes gerados por IA.

À medida que as ferramentas de IA evoluem, a vulnerabilidade não se restringe apenas a figuras públicas. Pessoas comuns, que não são famosas, também podem ter suas imagens e palavras distorcidas para manipulações. Pesquisadores alertam que a disseminação desenfreada de conteúdos sintéticos, muitas vezes referida como “AI slop” (ou “lixo de IA”), pode afastar usuários das redes sociais em busca de informações confiáveis e autênticas.